Microsoft khoe AI Phi-3 Mini: Thông minh như ChatGPT, nhưng chỉ cần điện thoại hoặc laptop xử lý

Đăng lúc

21:52 28.04.2024

Apple giới thiệu OpenELM, và Microsoft giới thiệu thế hệ mô hình AI Phi-3 trong cùng một ngày. Điểm chung của chúng rất rõ ràng, đó là những mô hình với tham số khác nhau của cả OpenELM lẫn Phi-3 đều đủ nhỏ gọn để xử lý trên chip trong điện thoại hoặc máy tính của người dùng, tức là dịch vụ AI có thể xử lý local, thay vì cần tới kết nối internet để máy chủ đám mây xử lý.

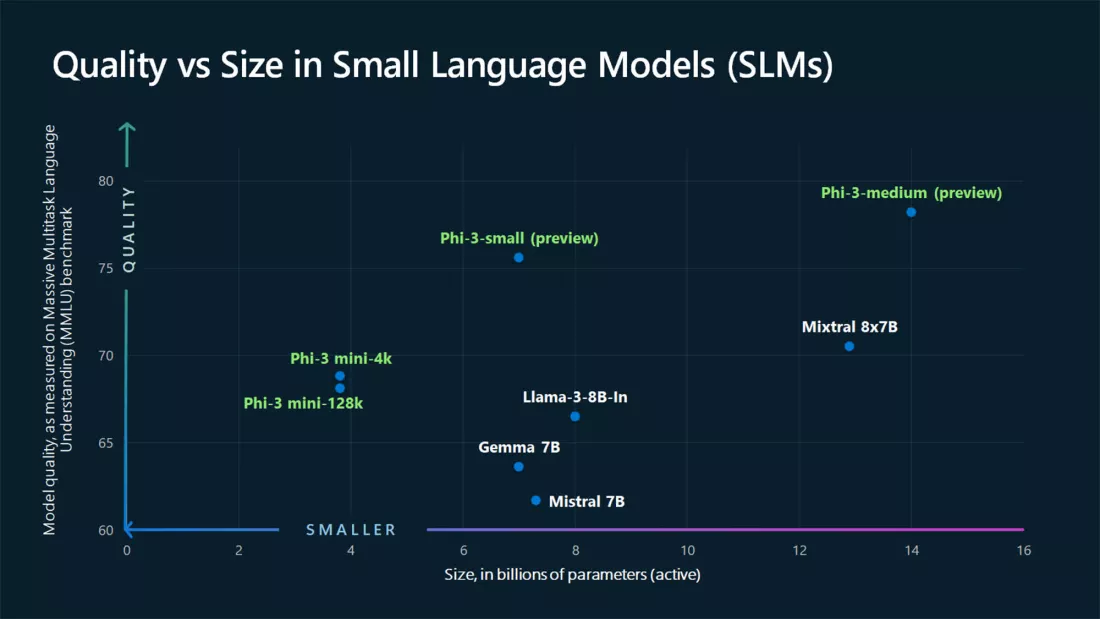

Nếu như OpenELM của Apple có tới 8 phiên bản khác nhau, tùy thuộc vào lượng tham số mà mô hình có thể vận hành xử lý, thì Phi-3 chỉ có ba phiên bản: Mini, Small và Medium.

Theo dữ liệu của Microsoft chia sẻ, dù chỉ có 3.8 tỷ tham số, nhưng khả năng vận hành của Phi-3 Mini hoàn toàn có thể trở thành một lựa chọn hoàn hảo để tạo ra những giải pháp ứng dụng trên Windows hay smartphone phục vụ hàng tỷ người dùng, nhất là trên những SoC có cụm nhân NPU xử lý thuật toán deep learning từ các hãng như Intel, Qualcomm, AMD và cả Apple.

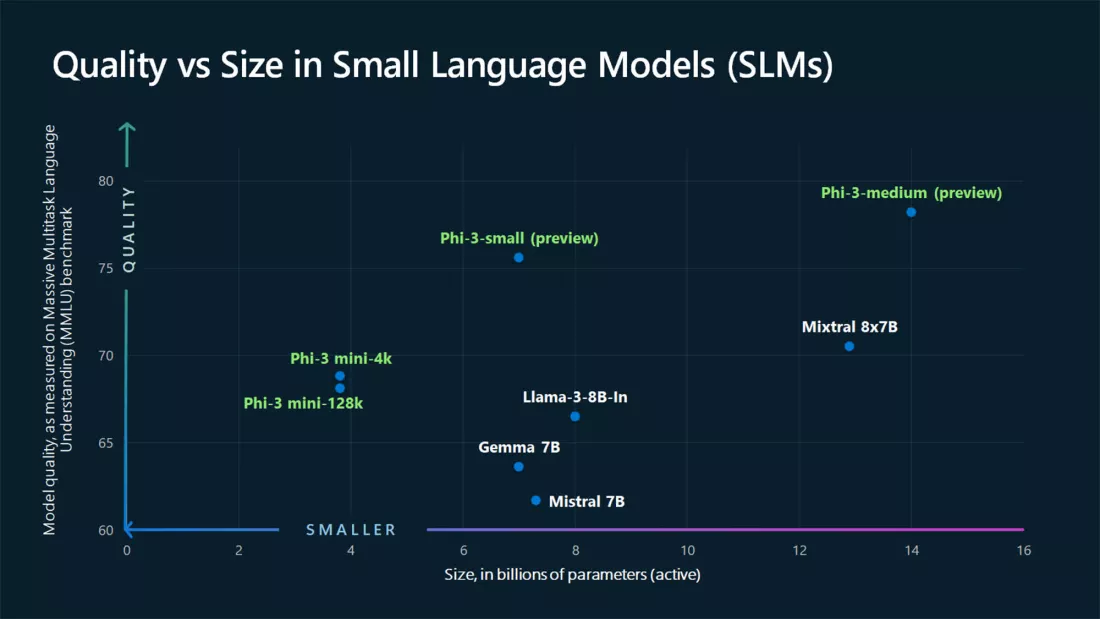

Microsoft công bố kết quả nghiên cứu, cho thấy rằng dù chỉ vận hành dựa trên 3.8 tỷ tham số, nhưng hiệu năng tạo sinh nội dung của Phi-3 Mini không hề thua kém quá xa so với GPT-3.5, công cụ vận hành phiên bản miễn phí của ChatGPT, vận hành dựa trên hơn 175 tỷ tham số, cũng như mô hình Mixtral 8x7B của startup Pháp Mistral.

Bản thân CEO OpenAI, Sam Altman cũng từng giải thích như thế này. Hầu hết thời gian, những mô hình ngôn ngữ vận hành trên tổng tham số càng lớn thì càng hiểu rõ câu hỏi và lệnh của người dùng, vì tham số là giá trị quyết định cách mô hình AI xử lý và tạo sinh văn bản và nội dung. Nhưng tham số càng lớn thì yêu cầu sức mạnh xử lý sẽ càng cao. Tuy nhiên không phải lúc nào quy luật cũng rõ ràng như vậy.

Những mô hình kích thước khủng như GPT-4 của OpenAI hay Claude 3 Opus của Anthropic vận hành dựa trên hàng trăm tỷ tham số, và chúng cần tới sức mạnh của cả những hệ thống data center khổng lồ, không chỉ để vận hành mà còn phục vụ hàng triệu người dùng cùng một lúc. Còn với những mô hình AI xử lý local, đột phá của các nhà nghiên cứu được tạo ra trong quá trình tinh chỉnh cơ sở dữ liệu đầu vào để huấn luyện mô hình AI.

Kết quả, Phi-3 Mini với 3.8 tỷ tham số có hai phiên bản. Một trong số đó có khả năng hiểu được ngữ cảnh 4000 token do người dùng nhập. Phiên bản còn lại hiểu được ngữ cảnh tối đa 128 nghìn token văn bản. Microsoft giải thích việc mô hình AI “cỡ nhỏ” nhưng có hiệu năng so sánh được với những AI với tham số gấp cả trăm lần: “AI được huấn luyện dựa trên những dữ liệu giống hệt như sách giáo khoa, từ những văn bản và tài liệu có chất lượng, giải thích mọi thứ cực kỳ chi tiết, nên việc tạo ra mô hình ngôn ngữ có thể đọc và hiểu những nội dung nhập liệu cũng dễ hơn rất nhiều.”

Về mặt ứng dụng, không loại trừ khả năng Phi-3 Mini hoàn toàn có thể được tích hợp vào những ứng dụng trên Android, trên iOS của Copilot, hay chính bản thân những chiếc laptop chạy Windows để xử lý chatbot hoặc trợ lý ảo xử lý local, miễn là thiết bị có cụm nhân NPU tăng tốc xử lý machine learning.

Theo Techspot

Apple giới thiệu OpenELM: Mô hình AI vận hành trên chip iPhone, có 8 phiên bản khác nhau

Apple có thể đi sau OpenAI hay Google trong cuộc chạy đua AI, nhưng tốc độ họ nghiên cứu và công bố những sản phẩm mới, dự kiến sử dụng làm nền tảng cho những sản phẩm AI ứng dụng trong thiết bị công nghệ họ bán ra thị trường thì thực sự chóng mặt.

HocVienDaoTao.com

Nếu như OpenELM của Apple có tới 8 phiên bản khác nhau, tùy thuộc vào lượng tham số mà mô hình có thể vận hành xử lý, thì Phi-3 chỉ có ba phiên bản: Mini, Small và Medium.

- Phi-3 Mini: 3.8 tỷ tham số

- Phi-3 Small: 7 tỷ tham số

- Phi-3 Medium: 14 tỷ tham số

Theo dữ liệu của Microsoft chia sẻ, dù chỉ có 3.8 tỷ tham số, nhưng khả năng vận hành của Phi-3 Mini hoàn toàn có thể trở thành một lựa chọn hoàn hảo để tạo ra những giải pháp ứng dụng trên Windows hay smartphone phục vụ hàng tỷ người dùng, nhất là trên những SoC có cụm nhân NPU xử lý thuật toán deep learning từ các hãng như Intel, Qualcomm, AMD và cả Apple.

Microsoft công bố kết quả nghiên cứu, cho thấy rằng dù chỉ vận hành dựa trên 3.8 tỷ tham số, nhưng hiệu năng tạo sinh nội dung của Phi-3 Mini không hề thua kém quá xa so với GPT-3.5, công cụ vận hành phiên bản miễn phí của ChatGPT, vận hành dựa trên hơn 175 tỷ tham số, cũng như mô hình Mixtral 8x7B của startup Pháp Mistral.

Bản thân CEO OpenAI, Sam Altman cũng từng giải thích như thế này. Hầu hết thời gian, những mô hình ngôn ngữ vận hành trên tổng tham số càng lớn thì càng hiểu rõ câu hỏi và lệnh của người dùng, vì tham số là giá trị quyết định cách mô hình AI xử lý và tạo sinh văn bản và nội dung. Nhưng tham số càng lớn thì yêu cầu sức mạnh xử lý sẽ càng cao. Tuy nhiên không phải lúc nào quy luật cũng rõ ràng như vậy.

Những mô hình kích thước khủng như GPT-4 của OpenAI hay Claude 3 Opus của Anthropic vận hành dựa trên hàng trăm tỷ tham số, và chúng cần tới sức mạnh của cả những hệ thống data center khổng lồ, không chỉ để vận hành mà còn phục vụ hàng triệu người dùng cùng một lúc. Còn với những mô hình AI xử lý local, đột phá của các nhà nghiên cứu được tạo ra trong quá trình tinh chỉnh cơ sở dữ liệu đầu vào để huấn luyện mô hình AI.

Kết quả, Phi-3 Mini với 3.8 tỷ tham số có hai phiên bản. Một trong số đó có khả năng hiểu được ngữ cảnh 4000 token do người dùng nhập. Phiên bản còn lại hiểu được ngữ cảnh tối đa 128 nghìn token văn bản. Microsoft giải thích việc mô hình AI “cỡ nhỏ” nhưng có hiệu năng so sánh được với những AI với tham số gấp cả trăm lần: “AI được huấn luyện dựa trên những dữ liệu giống hệt như sách giáo khoa, từ những văn bản và tài liệu có chất lượng, giải thích mọi thứ cực kỳ chi tiết, nên việc tạo ra mô hình ngôn ngữ có thể đọc và hiểu những nội dung nhập liệu cũng dễ hơn rất nhiều.”

Về mặt ứng dụng, không loại trừ khả năng Phi-3 Mini hoàn toàn có thể được tích hợp vào những ứng dụng trên Android, trên iOS của Copilot, hay chính bản thân những chiếc laptop chạy Windows để xử lý chatbot hoặc trợ lý ảo xử lý local, miễn là thiết bị có cụm nhân NPU tăng tốc xử lý machine learning.

Theo Techspot

ĐĂNG KÝ/LIÊN HỆ:

- Tòa nhà The GoldenPalm, 21 Lê Văn Lương, Phường Nhân Chính, Thanh Xuân, Hà Nội.

- 098 909 5293

- hotrotudaotao@gmail.com

- DINH FAMILY lIBRARY

- YouTube